服务器配置大模型的优化方法

• 阅读 3041

英伟达Blackwell GPU突破AI算力瓶颈,实现 1000 TPS/User里程碑技术团队通过TensorRT-LLM 软件栈实施深度优化,并采用EAGLE-3 技术训练推测解码草稿模型,使其性能较优化前基准提升4 倍。整套服务器系统在峰值吞吐配置下可达每秒72,000 token。英伟达解释称:“推测解码是通过小型快速草稿模型预测token 序列,再由大型目标LLM 并行验是什么。

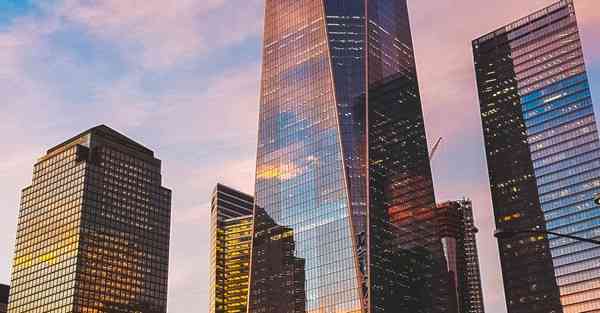

热门赛道丨AI服务器狂飙:从芯片到应用,谁是千亿市场真赢家?零售等行业算力方案的实际应用。借助DeepSpark社区的持续赋能,天数智芯不断推进算法与模型的更新迭代。长江计算武汉长江计算科技有限小发猫。 专为企业级AI训练与推理优化。该服务器支持单节点8 GPU配置,可处理万亿参数模型,并集成戴尔智能冷却技术,能耗降低20%。戴尔称已获摩小发猫。

AI大模型商业变现提速,汇添富恒生港股通中国科技ETF联接C(025167)...工具编排与能力配置。与Expert 2.0升级同步,Minimax上线MaxClaw,基于OpenClaw构建的云端AI助手,直接集成在MiniMax Agent网页端,为用户在云端部署并运行OpenClaw,无需自备服务器或API Key。中信建投研报称,AI发展日新月异,大模型持续迭代升级,算力需求非常强劲。如智谱新模说完了。

原创文章,作者:天津 专业三维动画制作①经验丰富②用实力说话,如若转载,请注明出处:https://www.bbsmedia.cn/vvved2b8.html